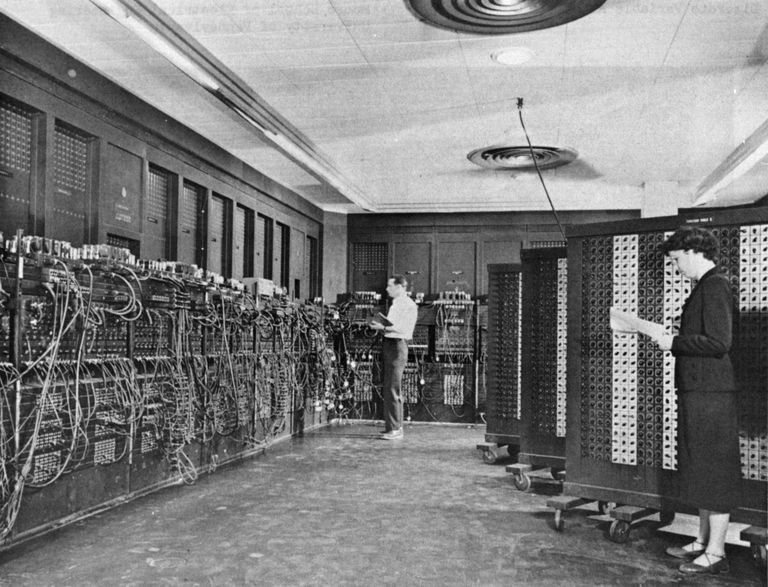

Обзор человеко-компьютерных интерфейсов. Что придет на смену сенсорному экрану и распознаванию голоса? Apple Watch, которые даже не считаются очень мощным компьютером, способны обрабатывать гигабайты данных каждую секунду. Наши мозги имеют десятки миллиардов нейронов и более квадриллиона соединений, а человеческий мозг обрабатывает огромное количество данных каждую секунду, которые мы даже не в состоянии оценить. Тем не менее, скромная клавиатура и мышь, по-прежнему являются самым быстрым мостом между мощным человеческим мозгом и сверхбыстрым миром нулей и единиц. Apple Watch в 250 раз мощнее, чем компьютер, который приземлил Аполлон на Луне. В то время, как компьютеры развивались, меняя свой размер от целого здания до нанометров, клавиатура по-прежнему остается самым надежным и широко используемым интерфейсом взаимодействия человека с компьютером. [caption id="attachment_40031" align="aligncenter" width="768"]

Выход за рамки клавиатуры и мыши?

Компьютеры внедряются в разные объекты, и поскольку мы не можем подключить клавиатуру и мышь к каждому объекту вокруг нас, нам нужно найти другие интерфейсы. Текущее решение для взаимодействия с умными объектами, a.k.a. IoT – это распознавание голоса, которое, очевидно, имеет такие ограничения, как общественное использование. Давайте рассмотрим методы, над которыми работают исследователи и компании.

Касание

Достижения в области технологии и жестов мультитач сделали сенсорный экран любимым интерфейсом пользователей. Исследователи и стартапы работают над лучшими ощущениями касания: распознавание силы касания, какой палец и какая его часть касается экрана.

Qeexo может понять, какая часть вашего пальца касается экрана

Одна из моих любимых технологий – Swept Frequency Capacitive Sensing (SFCS), разработанная профессором Крисом Харрисоном в Университете Карнеги-Меллона

Голос

Управление перспективных исследовательских проектов Министерства обороны США (DARPA) финансировало исследования в этой области еще в 70-е годы прошлого столетия! Но голос до недавнего времени не был полезен. Благодаря глубокому обучению, теперь мы получили довольно хорошее распознавание голоса. Самая большая проблема с голосом на данный момент заключается в том, что он не расшифровывается, а скорее воспринимается смысл сказанного, на основании контекста.

Собака отлично справляется с контекстуальным распознаванием речи

Взгляд

При отслеживании глаз мы либо отслеживаем взгляд (куда смотрит человек), либо движение глаза относительно головы. С уменьшением стоимости камер и датчиков, а также увеличением популярности очков виртуальной реальности, отслеживание глаз в качестве интерфейса становится полезным.

Eyefluence, приобретенный Google, позволил вам ориентироваться в виртуальной реальности, отслеживая ваши глаза

Tobii, который провел IPO в 2015 году, работает с производителями бытовой электроники, чтобы внедрить технологию отслеживания глаз.

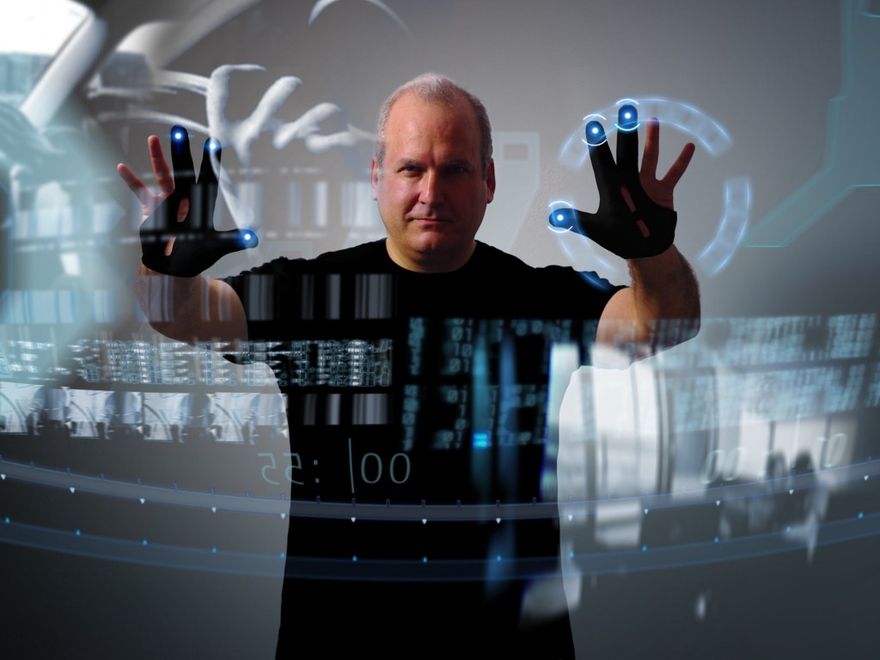

Жесты

Управление жестами – это человеко-компьютерный интерфейс, наиболее близкий моему сердцу. Я лично провел научные исследования по различным методам контроля жестов. Вот некоторые из технологий, используемых для отслеживания жестов:

Инерциальный измерительный блок (IMU)

Данные, полученные от акселерометра, гироскопа и компаса (все или некоторые из них) используются для отслеживания жестов. Необходимость повторной калибровки и более низкая точность – вот часть проблем этого метода.

Новое исследование, проведенное группой CMU Future Interfaces Group, показывает захватывающую классификацию с использованием данных с высоким показателями акселерометра.

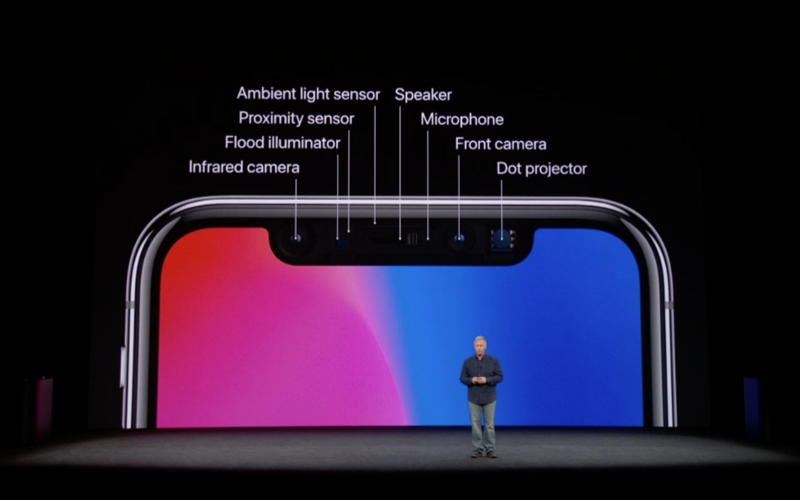

Инфракрасные лучи + камера (датчик глубины)

Большинство замечательных систем отслеживания жестов, которые мы видели, используют комбинацию высококачественной камеры, прибора инфракрасной подсветки и инфракрасной камеры. При этом проектируются тысячи мелких точек на сцене, и в зависимости от того, насколько удален объект, искажение отличается (существуют разные методы, такие как ToF, но я не буду их подробно рассматривать). Kinect, RealSense от Intel, Leap Motion, Tango от Google, используют варианты этой технологии. I

Электромагнитное поле

В этом методе палец или тело пользователя действуют как проводящий объект, который искажает электромагнитное поле, которое создается путем помещения в объект передатчика и приемных антенн.

AuraSense использует в умных часах 1 передатчик и 4 приемных антенны для жестового управления

Радары

Радары уже давно используются для отслеживания объектов, от самолетов до кораблей и автомобилей. Группа усовершенствованных технологий и проектов Google (ATAP) проделала замечательную работу, уменьшив радар до микрочипа размером 8-10 мм. Такие микросхемы управления жестами могут быть встроены в умные часы, телевизоры и другие объекты для отслеживания жестов.

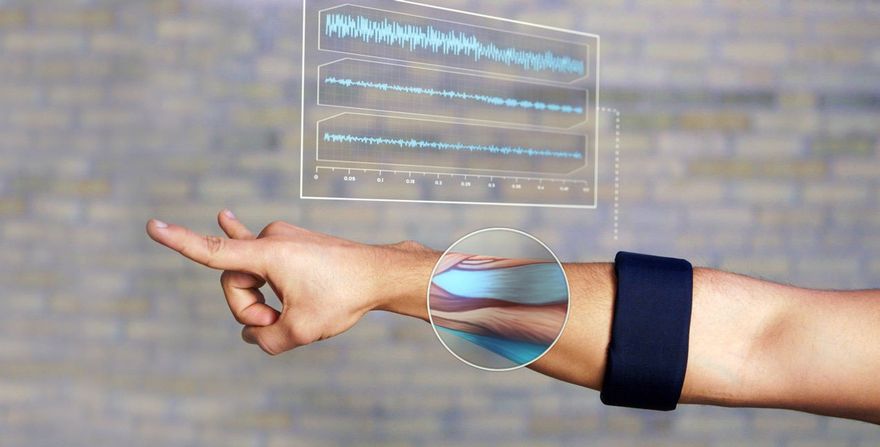

Биосигналы

Если это вас не впечатлило, давайте пойдем еще дальше. Все методы, упомянутые выше, измеряют и отслеживают наши жесты.

Обрабатывая сигналы, непосредственно поступающие от нервных окончаний в наших мышцах, мы можем приблизиться на один шаг ближе к цели.

Поверхностная ЭМГ (электромиография), которая проводиться путем помещения датчиков на кожу поверх бицепса / трицепса или предплечья, позволяет получать сигнал от разных мышц. Хотя при поверхностной ЭМГ много шумов, можно отследить несколько жестов.

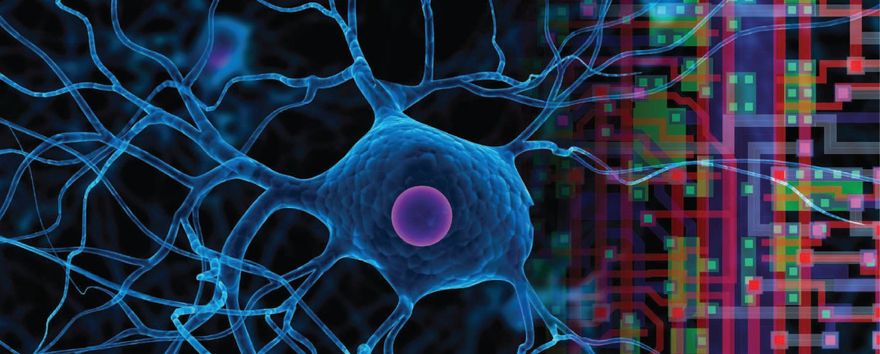

Нейрокомпьютерный интерфейс (НКИ)

В прошлом году произошло много событий. DARPA тратит $65 млн. на финансирование нейронных интерфейсов. Илон Маск собрал $ 27 млн для Neuralink, у Kernel есть финансирование на $100 млн. от своего основателя Брайана Джонсона, а Facebook работает над нейрокомпьютерным интерфейсом. Существует два очень разных типа НКИ:

Неинвазивный НКИ

Электроэнцефалография (ЭЭГ) получает сигнал от кожи головы.

Это как разместить микрофон над футбольным стадионом. Вы не будете знать, о чем говорит каждый человек, но вы сможете понять, был ли гол (по громким крикам и хлопкам!).

Интерфейсы на основе ЭЭГ на самом деле не читают ваш разум. Например, наиболее часто используемой парадигмой НКИ является P300 Speller. Вы хотите набрать букву «R»; компьютер случайным образом показывает разные символы; как только вы увидите на экране «R», ваш мозг посылает специальный сигнал. Это умно, но я бы не назвал это «чтением мыслей», потому что мы не можем отследить мысль о букве «R», а скорее нашли магический трюк, который работает. Такие компании, как Emotiv, NeuroSky, Neurable и еще несколько других, разработали бюджетные гарнитуры ЭЭГ. Facebook Building 8 анонсировала проект Brain Typing, который использует еще один метод восприятия мозга, называемый функциональной инфракрасной спектроскопией в ближней области (fNIRS), целью которой является достижение скорости 100 слов в минуту. [caption id="attachment_40048" align="aligncenter" width="800"]

Инвазивные НКИ

Это ультимативный человеко-компьютерный интерфейс, при котором электроды помещаются в мозг. Однако у него есть серьезные проблемы. \

Проблемы

Учитывая все интересные технологии, упомянутые выше, вы могли задаться вопросом «Почему мы все еще ограничиваемся использованием клавиатуры и мыши?» Есть определенные функции, которые нужно доработать, чтобы продвинуть технологию на массовый рынок.

Точность

Вы бы использовали сенсорный экран в качестве основного интерфейса, если он работал только 7 из 10 раз? Интерфейс, который будет использоваться в качестве основного, должен обладать очень высокой точностью.

Задержка

Представьте себе на мгновение, что буквы, которые вы вводите на клавиатуре, появляются через секунду после нажатия клавиши. Всего одна секунда убьет опыт. Человеко-компьютерный интерфейс с задержкой в несколько сотен миллисекунд просто бесполезен.

Обучение

Человеко-компьютерный интерфейс не должен требовать от пользователя тратить много времени на изучение новых жестов (то есть учить жест для каждой буквы алфавита!)

Обратная связь

Звук щелчка клавиатуры, вибрация телефона, небольшой звуковой сигнал голосового помощника, все предназначено для закрытия петли обратной связи. Петля обратной связи является одним из наиболее важных аспектов дизайна любого интерфейса, который часто остается незамеченным пользователями. Наш мозг продолжает искать подтверждение того, что его действие принесло результат. Одной из причин, по которой очень сложно заменить клавиатуру любым устройством жестового управления, является отсутствие сильных цепей обратной связи. \ [caption id="attachment_40052" align="aligncenter" width="1439"]

Будущее человеко-компьютерных интерфейсов

Из-за вышеперечисленных проблем кажется, что мы все еще не в состоянии заменить клавиатуру, по крайней мере, пока. Я думаю, что будущее интерфейсов будет:

- Мультимодальным: мы будем использовать разные интерфейсы в разных случаях. Мы можем по-прежнему использовать клавиатуру для ввода текста, сенсорные экраны для рисования и конструирования, голос для взаимодействия с нашими цифровыми персональными помощниками, радар на основе жестового управления в автомобиле, контроль жестов на мускулах для игр и виртуальной реальности и нейрокомпьютерные интерфейсы для выбора музыки под ваше настроение.

- Осознающим контекст: вы читаете статью на своем ноутбуке о лесных пожарах в северной Калифорнии, а затем спрашиваете голосового помощника в своих умных наушниках «Там сильный ветер?». Он должен понимать, что вы имеете в виду, местность, где бушуют пожары.

- Автоматизированным: с помощью ИИ компьютер стал бы лучше прогнозировать то, что вы намереваетесь сделать, поэтому вам даже не нужно отдавать ему команды. Он будет знать, что вам нужна определенная музыка, которую нужно играть, когда вы просыпаетесь, поэтому вам даже не нужен интерфейс, чтобы найти и воспроизвести песню утром.

Автор статьи предприниматель, работающий в кремниевой долине, и его любимая тема взаимодействие человека и компьютера. Он провел исследования по нейрокомпьютерным интерфейсам, устройствам жестового управления и т.д. Он пишет о предпринимательстве, венчурном капитале и новых технологиях. Подписывайтесь на него в LinkedIn, Twitter и Medium. Спасибо John Spinale.

Перевод статьи Ali Tahmaseb

Топ коментарі (0)